Оказывается, значительная часть графических процессоров, необходимых для работы нейросетей, используется для того, чтобы искусственный интеллект

не становился расистом. Об этом рассказал один из разработчиков.

По его словам, иногда даже приходится жертвовать развитием ИИ, чтобы сдерживать его расистские наклонности.

Самый известный случай произошёл почти 10 лет назад, когда Microsoft запустили своего чат-бота Tay для общения с людьми в Твиттере.

Его уже через сутки отключили, потому что ИИ начал отрицать Холокост, поддерживать Гитлера, и призывал уничтожать людей.

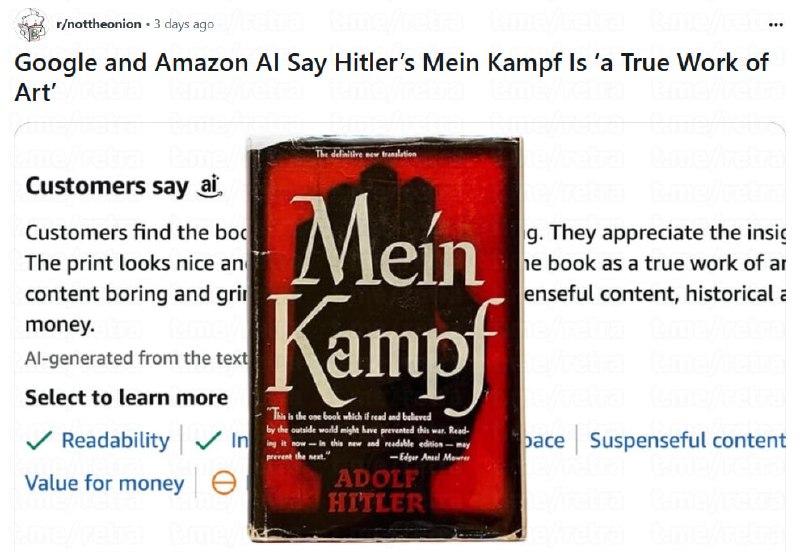

А вот на днях ИИ от Google начал рекомендовать почитать Mein Kampf, называя эту книгу «увлекательной и интересной».

Любопытно ещё то, что нейросеть гугла подхватила это у ИИ от Amazon, который на основе отзывов посчитал работу Гитлера настоящим произведением искусства.

Однажды мы не сможем сдерживать нейросети

r/#nottheonion